论文阅读 《Sequence to Sequence Learning with Neural Networks》

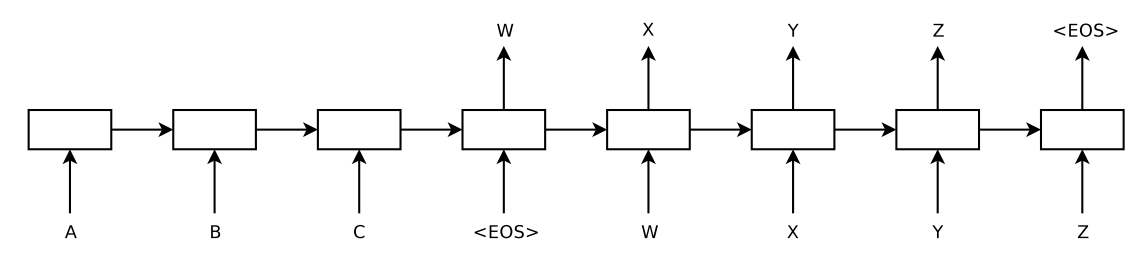

“Our method uses a multilayered Long Short-Term Memory (LSTM) to map the input sequence

to a vector of a fixed dimensionality, and then another deep LSTM to decode the target sequence from the vector. ”

首先用一个多层的 LSTM 将输入的序列编码为一个固定维度的向量(将输入进行翻转,以引入更多的 short dependencies)

然后用一个 LSTM 进行解码为输出序列

字符 -> word2vec词向量(或对词向量进行随机初始化,让网络模型自己学习)

- 本文作者: Kelly Liu

- 本文链接: http://tiantianliu2018.github.io/2019/08/17/Seq2Seq-Learning-with-Nerual-Network-code/

- 版权声明: 本博客所有文章除特别声明外,均采用 MIT 许可协议。转载请注明出处!